随机变量序列的两种收敛性

依概率收敛

定义

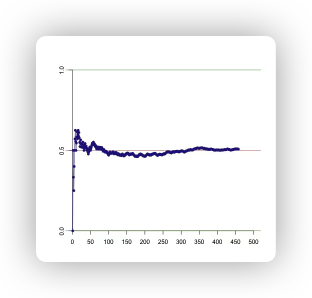

例子: 抛一个均匀的硬币,正面朝上和反面朝上的概率是相等的。我们把正面朝上的频率记为 $v_n=S_n/n$,其中$S_n$为正面朝上出现的次数,n为抛硬币的总次数,那么当把硬币一直抛下去,我们会发现频率序列 ${v_n}$ 会出现两个现象:

- 频率$v_n$ 对频率p的绝对偏差$|v_n-p|$ 将随着n的增大而呈现逐渐减小的趋势,但无法说它就收敛域0

- 由于频率的随机性,绝对偏差 $|v_n-p|$ 时大时小,虽然我们无法排除大偏差发生的可能性,但随着n的不断增大,大偏差发生的可能性会越来越小。 这是一种新的极限概念

下面我们给出具体的定义:

设${X_n}$ 为一随机变量序列,X为一随机变量,如果对任意的 $\epsilon>0$ ,有

则称${X_n}$ 依概率收敛于 $X$ ,记作 $X_p\xrightarrow{p}X$

依概率收敛的含义是: $X_n$ 对X 的绝对偏差不小于任意给定量的可能性将随着n的增大而越来越小。反过来说,绝对偏差$|X_n-X|$ 小于任一给定量的可能性将随着 $n$ 的增大而越来越接近与1。即上式可等价于:

特别的,我们要学习一种退化分布(单点分布),这是一种最简单的离散型分布。其概率函数为:

当$X$ 为退化分布时,即$P(X=c)=1$, 则称序列 ${X_n}$ 依概率收敛于c,即$X_n\xrightarrow{~P~}c$

性质

符合四则运算

设 ${X_n},{Y_n}$ 是两个随机变量序列, $a,b$ 是两个常数,如果

则有:

也就是说依概率分布满足四则运算

适用于函数

如果 $X_n\xrightarrow {~P~} X,g(x)$ 是直线上的连续函数,则: $g(X_n)\xrightarrow Pg(X)$

例题:

如果 $X_n\xrightarrow P a$, 则对任意常数c,试证: $cX_n\xrightarrow P ca$

我们可以令 $g(x) = cx$, 那么 $g(X_n) = cX_n\xrightarrow {~P~}g(a) = ca $ 得证。

按分布收敛、弱收敛

我们知道分布函数可以描述随机变量的统计规律,因此讨论一个分布函数序列${F_n(x)}$收敛到一个极限分布函数$F(x)$ 是有实际意义的。那么,如何来定义${F_n(x)}$的敛散性呢?

我们给出一些关于分布函数列的弱收敛定义:

对$F(x)$ 的任一连续点x,都有

则称${F_n(x)}$ 弱收敛于$F(x)$, 记作:

也称相应的随机变量序列 ${X_n}$ 按分布收敛与X,记作

注意,这里要区分弱收敛和按分布收敛的异同,这是在两种不同场合给出的两种不同名称,其本质含义是一样的:

- 分布函数序列${F_n(x)}$ 称为弱收敛

- 随机变量序列 ${X_n}$ 则称为按分布收敛,

此外,还要注意是任一连续点,可以不包括离散点。若把离散点也囊括在内,那么这个条件就太强了,有很多反例。

定理1

也就是说,可以由依概率收敛推出按分部收敛。但是,这个定理的逆命题是不成立的。下面给一个反例:

反例

设随机变量X的分布列:

令 $X_n=-X$, 则$X_n$ 与$X$ 同分布,即$X_n$ 与 $X$,有相同的分布函数,故 $X_n\xrightarrow{L}X$

但是对于任意的$0<\epsilon<2$ ,有:

即,一般按分部收敛与依概率收敛是不等价的

定理2

若c为常数,则 $X_n\xrightarrow{~P~} c$ 的充要条件是 $X_n\xrightarrow{~~L~} c$

这个定理说明,当极限随机变量为常数(服从退化分布时),按分布收敛与依概率收敛是等价的。

例题:1

设 $D(x)$ 为退化分布:

试问下列分布函数列的极限函数是否仍然为分布函数?(其中 $n=1,2\cdots$)

- ${D(x+n)}$

首先我们要求该分布函数列的极限函数F(x), 当 $n\rightarrow \infty$时候

显然,$ D(x+n) = 0$ 是不可能出现的, 极限函数 $G(x) = 1, x\in R$

这是不符合分布函数的性质:$\lim\limits_{n\rightarrow -\infty} G(x) = 0$

- ${D(x+1/n)}$

对于这个函数列,当$n\rightarrow \infty$ 时,$\frac{1}{n}\rightarrow 0$

那么,其极限函数为

这符合极限函数的右连续性

- ${D(x-1/n)}$

这个函数列可写为:

那么,当 $n\rightarrow \infty$ 时,其极限函数可写为:

这时候,极限函数不满足分布函数的右连续性,所以这不是一个分布函数。

例题2

如果$X_n\xrightarrow L X$,且数列 $a_n\rightarrow a,b_n\rightarrow b$, 试证: $a_nX_n+b_n\xrightarrow L aX+b$

以概率1收敛

依概率1收敛亦称几乎必然收敛、几乎处处收敛、几乎肯定收敛,是随机变量列的一种较强的收敛性。若随机变量列以概率1收敛,则它必然依概率收敛,反之则未必。

大数定律

大数定律一般形式

设有一随机变量序列${X_n}$,加入它具有下列这个式子的性质,则称该随机变量序列${X_n}$ 服从大数定律:

对于任意的 $\epsilon >0$, 有

常用的大数定律

现在已经知道了大数定律的一般形式,其实,常用的大数定律就是在不同条件下的一般情况的变形。

伯努利大数定律

设$S_n$ 为 n重伯努利试验中事件A出现的次数,称 $\frac{S_n}{n}$ 为事件A出现的频率。

那么如果记一次实验中A发生的概率为p,则$S_n$ 服从二项分布$b(n,p)$, 因此频率 $\frac{S_n}{n}$ 的数学期望与方差分别为:

下面,给出伯努利大数定律的定义:

证明:我们可以用切比雪夫不等式$P(|X-E(X)|\geq \epsilon)\leq \frac{Var(X)}{\epsilon^2}$ 得:

当$n\rightarrow \infty$ 时,上式右端趋于1,因此:

伯努利大数定律说明:随着 n 的增大,事件 A 发生的频率$\frac{S_n}{n}$ 与其概率p 的偏差 $|\frac{S_n}n -p|$ 大于与现给定的精度$\epsilon$ 的可能性愈来愈小。这就是频率稳定与概率的意义

切比雪夫大数定律

切比雪夫大数定律也可以由切比雪夫不等式证明。

定义:

设${X_n}$为一列两两不相关的随机变量序列,若每个$X_i$ 的方差存在,且有共同的上界,即 $Var(X_i)\leq c,i=1,2\cdots,$ 则 ${X_n}$服从大数定律,即对任意的 $\epsilon >0$, 满足:

注意,切比雪夫大数定律只要求 ${X_n}$ 互不相关,并不要求他们是同分布的,因此,我们很容易推出:如果${X_n}$ 是独立同分布的随机变量数列,且方差有限,那么${X_n }$必定服从大数定律

伯努利大数定律只是切比雪夫大数定律的特例

例题:

设 ${X_n}$ 是独立同分布的随机变量序列,$E(X_n^4)<\infty$. 若令 $E(X_n)=\mu,Var(X_n)=\sigma^2$, 考察

证明随机变量序列 ${Y_n}$ 服从大数定律,即对任意的 $\epsilon > 0$, 有:

解答思路:

首先,要满足大数定律,必须要让$Y_n$是独立同分布的(显然),且方差有限(需证)

其次,要满足上式,第一部分 $\frac{1}{n}\sum{i=1}^n Y_i$ 是不用计算的,带入$Y_n$即可;第二部分$\frac{1}{n}\sum{i=1}^n E(Y_i)$ 是需要计算的部分。

根据上面这个思路,我们先证明方差是有限的:

已知 $E(X-E(X))^2=Var(X)$ 上式可化简为:

因为 $E(X_n^4)$ 存在,故 $E(X_n^3),E(X_n^2),E[(X-\mu)^4]$ 也存在,因此$Y_n$的方差是存在的。

然后我们化简 $\frac{1}{n}\sum_{i=1}^nE(Y_i)$,

因此

得证。

马尔科夫大数定律

注意到以上大数定律的证明中,只要有

则大数定律就能成立,这个条件就被称为马尔科夫条件

现在给出马尔科夫大数定律的定义:

对随机变量序列${X_n}$ ,若上面的马尔科夫条件成立,则${X_n}$服从大数定律

马尔科夫大数定律的重要性在于:对${X_n} $ 已经没有任何 同分布、独立性、不相关 的假定,切比雪夫大数定律显然可以由马尔科夫大数定律推出。

例题:

设 ${Xn}$ 为一同分布、方差存在 的随机变量序列,且$X_n$ 仅与相邻的 $X{n-1}$ 和 $X_{n+1}$ 相关,而与其他的 $X_i$ 不相关。试问该随机变量序列 ${X_n}$ 是否服从大数定律?

要看是否服从,可以看其是否满足马尔科夫条件:

记 $Var(X_n)=\sigma^2$,则 $|Cov(X_i,X_j)|\leq \sigma^2$ 于是有:

也就是满足马尔科夫条件,则${X_n}$服从大数定律

辛钦大数定律

以上三个大数定律都假设随机变量序列 ${X_n}$ 的方差存在,以下的辛钦大数定律去掉了这一假设,仅设每个$X_i$ 的数学期望存在(因为数学期望存在并不能够推断数学方差存在)。但与此同时,要求${X_n}$为独立同分布的随机变量序列。因此,伯努利大数定律除了是切比雪夫不等式得特例外,也是辛钦大数定律的特例。

定义: 设${X_n}$ 为一独立同分布的随机变量序列,若$X_i$ 的数学期望存在,则 ${X_n}$ 符合大数定律,即对任意的$\epsilon > 0$ ,

成立。

所以说,像柯西分布这样的是不能用辛钦大数定律来

辛钦大数定律提供了求随机变量数学期望$E(X)$ 的近似值的方法: 设想对随机变量X独立重复地观察n次,第k次的观察值为$Xk$ , 则 $X_1,X_2,X_3\cdots,X_n$ 应该是相互独立的,且它们的分布应该与 X 的分布相同。所以,在$E(X)$ 存在的条件下,按照辛钦大数定律,当n足够大的时候,可以把平均观察值:$\frac{1}{n}\sum{i=1}^n X_i$ 作为$E(X)$的近似值。这种做法的一个有点事我们可以不用去了解X的分布是什么。

此外,我们还要记住,如果${Xn}$为一独立同分布的随机变量序列,且 $E(|X_i|^k)$ 存在,其中k为正整数,则 ${X_n^k}$ 服从大数定律。也就是说我们可以用 $\frac{1}{n} \sum{i=1}^n X_i^k$ 作为 $E(X_i^k)$ 的近似值。

利用蒙特卡洛方法计算定积分

计算定积分:

设随机变量X服从$(0,1)$上的均匀分布,则 $Y=f(x)$ 的数学期望是:

所以估计J的值,就是估计$f(X)$ 数学期望的值。 由辛钦大数定律,可以用 $f(X)$的观察值的平均去估计$f(X)$的数学期望的值。

先用计算机产生n个$(0,1)$上的均匀分布的随机数$x_i,i=1,2\cdots,n$

然后对每个$x_i$计算$f(x_i)$

最后得J的估计值为:

| 常见的大数定律 | 需满足的条件 |

|---|---|

| 伯努利大数定律 | $Sn$ 服从二项分布,单个样本服从独立同分布的二点分布 |

| 切比雪夫大数定律 | ${X_n}$ 互不相关(并不是互相独立),且有共同的方差上界 |

| 马尔科夫大数定律 | 没其他的要求,只要$\frac{1}{n^2} Var(\sum_{i=1}^n X_i)\rightarrow 0$ |

| 辛钦大数定律 | 设${X_n}$ 独立同分布的,且 $X_i$ 的数学期望存在 |

一般来说,都是利用马尔科夫大数定律来证明独立随机变量序列符合大数定律的

例题1

- 设 ${X_k}$ 为独立随机变量序列,且:$P(X_k = \pm \sqrt{\ln k})=\frac{1}{2}, k=1,2\cdots$ 服从大数定律

首先: 判断使用哪种大数定律来解, 显然这不是二项分布,$X_n$ 也不是同分布的,所以我们可以利用马尔科夫大数定律或者切比雪夫大数定律来求解

第二步:列出期望和方差: 在这题中,显然$E(X_k) = 0$, $Var(X_k) =2 \frac 12 (\sqrt {\ln k}-0)^2 =\ln k$ (这里可以判断出来,${X_n}$ 不满足有共同的方差上界,因此不能使用切比雪夫大数定律,只能使用马尔科夫大数定律)

第三步:判断是否满足马尔科夫条件 :由${Xn}$ 独立可知, $Var(\sum{i=1}^n Xi)= \sum{i=1}^n Var(X_i) \leq n\ln n$ , 因此:

符合,所以符合大数定律

例题2

在伯努利试验中,事件A出现的概率为p,令

证明${X_n}$符合大数定律

第一步:首先判断使用那种大数定律,显然 $Xn$ 不属于两点分布,不独立也不同分布($X_n$和$X{n+1}$相关)。所以只能选择马尔科夫大数定律

第二步:求E(x) 和Var(x) : 可以列出

因此$E(X_n)= p^2,Var(X_n)=p^2(1-p^2)$

第三步:判断是否满足马尔科夫大数定律

这里很重要的一点是,${X_n}$ 并不是互相独立的,因此我们在计算的时候需要加上协方差。

由协方差矩阵是一个非负定矩阵可得:

这里不可能等于0,因此

得证

例题3

设${X_n}$为独立同分布的随机变量序列,其共同分布:

试问其是否满足大数定律?

第一步:判断使用哪种大数定律

首先排除伯努利大数定律,又因为是独立同分布的,因此选择的范围很广,只要证明其期望存在就能利用辛钦大数定律证明其符合大数定律了。

第二步: 计算期望

根据数列的极限可以求出 $\sum_{i=1}^n\frac{1}{k^2}<2$ 显然是有限的,因此根据辛钦大数定律知${X_n}$ 服从大数定律。

例题4

- 设 ${Xn}$ 为独立同分布的随机变量序列,方差存在。又设 $\sum{i=1}^n an$ 为绝对收敛级数。 令 $Y_n = \sum{i=1}^n X_i$ 证明:${a_nY_n}$ 符合大数定律。

第一步:判断使用哪种大数定律

首先排除伯努利分布定律,其次 ${a_nY_n}$ 的期望和方差都比较难判断,所以我们需要一些技巧。

不妨设 $E(Xn) = 0$, 则$Var(X_n) =E(X_n^2) = \sigma^2$ . 又因为 $\sum{i=1}^na_n$ 收敛于常数,可以记为c。

可以尝试一下用马尔科夫大数定律来求解

第二步:

现在,我们就可以将化简后的式子带入马尔科夫条件:

也就是说,形如${anY_n}$,$Y_n = \sum{i=1}^n$的随机变量序列我们可以将其化简为:

的形式,然后,对 $a_i$ 进行放缩即可。

例题5

例题5和例题4 差不多,设${Xn}$ 为独立同分布的随机变量序列,方差存在,令 $Y_n = \sum{i=1}^n X_i$ 又设${a_n}$ 为一列常数,为一列常数,如果存在常数 $c>0$ , 使得对n 有 $|na_n|\leq c$ 证明 ${a_nY_n}$ 服从大数定律。

同样,我们先设 $E(X_n)=0$ ,则 $Var(X_n)=E(X_n^2) = \sigma^2$对任意的$n\geq k$

因而:

仿照例题4,我们可以证明:

中心极限定理

独立随机变量和

上一个part我们学的是大数定律,讨论的是在什么条件下,随机变量序列的算数平均依概率收敛到其均值的算数平均。

现在,我们来讨论在什么条件下,独立的随机变量和

的分布函数会收敛于正态分布

研究这个问题是很有用的,一个很大的应用场景就是误差。比如说

- 机床方面,有机床振动与转速的影响

- 环境方面,有车间的温度,湿度、照明、工作电压的影响

可以把这些误差的和记为$Y_n$ ,那么 $Y_n$是随机变量,可以将 $Y_n$看做是很多微小的随机波动之和:

当 $n\rightarrow \infty$ 时,$Y_n$的分布是什么?

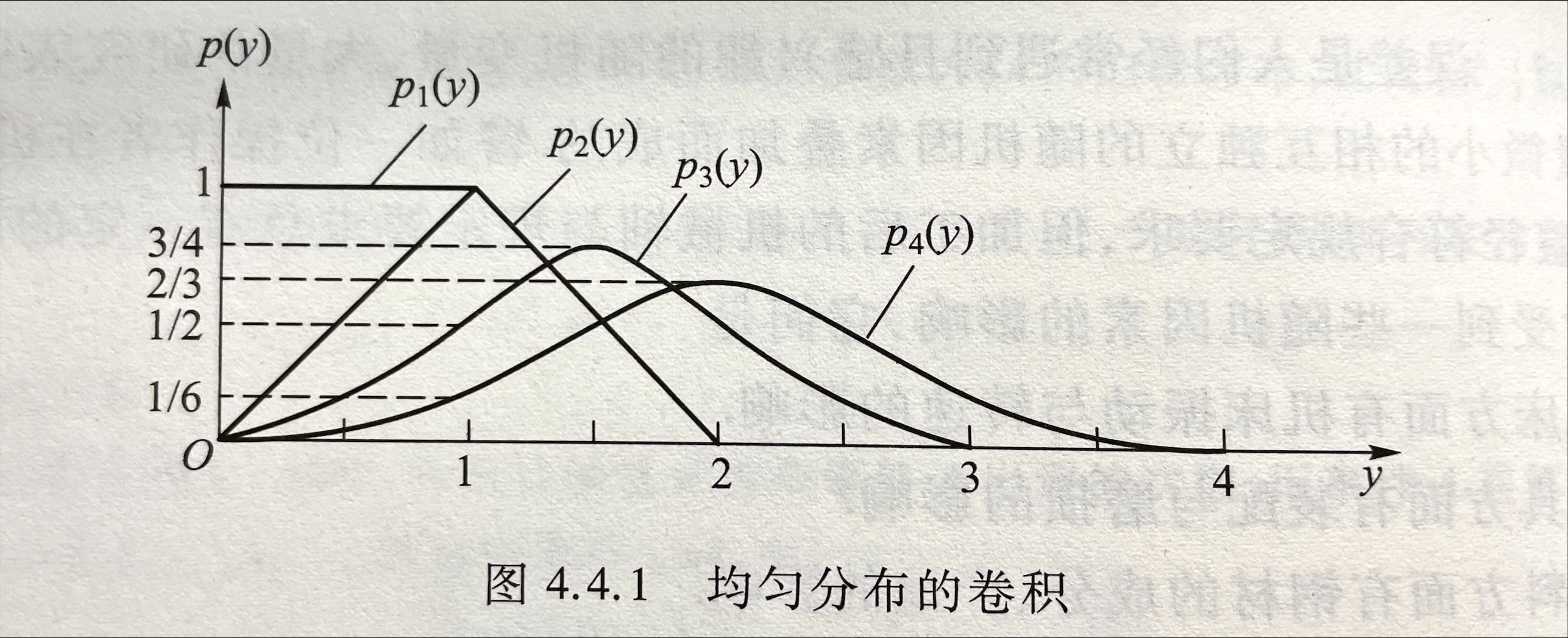

通过卷积可以看到,当n越来越大时,其分布就越来越像一个正态分布。

为了寻求 $Y_n$ 的极限分布有意义,有必要先研究一下问题的提法。上图可以看出:当 n 增大时,$p_n(y)$ 的中心右移,且$p_n(y)$的方差增大。这意味着,当 $n\rightarrow \infty$ 时,$Y_n$的分布中心也会趋向于 $\infty$,方差趋向 $\infty$。 说明分布是很不稳定的。

在中心极限定理的研究中,会对 $Y_n$ 进行标准化

由于 $E(Y_n^),Var(Y_n^)=1$,这就有可能看出 $Y_n^*$的极限分布是否为标准正态分布 $N(0,1)$

中心极限定理就是研究随机变量和的极限分布在什么条件下为正态分布的问题

独立同分布下中心极限定理

林德伯格-莱维中心极限定理

刚才我们给出了 $Y_n^*$ 的定义。那么当${X_n}$ 满足独立同分布的随机变量序列,且$E(X_i)=\mu,Var(X_i)=\sigma^2$ 都存在时,则对任意实数 y,

记

有

也就是说,当n充分大,就可以用正态分布去逼近随机变量和的分布。

二项分布的正态近似

棣莫弗-拉布拉斯中心极限定理

设 n 重伯努利试验中,事件A在每次试验中出现的概率为 p, 记$S_n$为n次试验中时间A出现的次数。

这时候, $Y_n^* = \frac{S_n - np}{\sqrt {npq}}$

则对任意实数y ,有:

注: 因为二项分布是离散分布,而正态分布是连续分布,所以用正态分布作为二项分布的近似计算中,做些修正可以体高精度: 若 $k_1<k_2$ 均为整数,一般先作如下修正后再用近似:

例题:

比如: $S_n\sim b(25,0.4),P(5\leq S_n\leq 15)$ 的值。使用修正的正态近似之后:($E(X) = np =10,Var(X) = np(1-p) = 6$)

此外,开可以用修正的正态近似来计算 $P(S_n=k)$

| 中心极限定理种类 | 需要满足的条件 |

|---|---|

| 林德伯格-莱维中心极限定理 | $ {X_n}$独立同分布且期望方差均存在 |

| 棣莫弗-拉布拉斯中心极限定理 | n重伯努利试验,事件A在每次试验中出现的概率为 p, 记$S_n$为n次试验中时间A出现的次数。 $Y_n^* = \frac{S_n - np}{\sqrt {npq}}$ |

重要应用

在中心极限定理的应用中,若记 $\beta =\Phi(y)$ ,则由这个中心极限定理给出的近似式:$P(Y_n^*\leq y)\approx \Phi(y) = \beta$

可以用来解决三类计算问题:

1. 已知$n,\beta$ 求 $y$

有一家珍珠奶茶店,只有两种产品,珍珠奶茶和纯奶茶。每杯珍珠奶茶里需要放5克珍珠。一天接单100笔,顾客以$\frac{1}{2}$的概率点珍珠奶茶。且假定顾客点单独立。有$95\%$ 的可能性不拒单。 问:要准备多少克珍珠?

解:我们设第i个顾客点珍珠奶茶记为 $X_i\sim b(1,p),p = 0.5$,

首先我们把已知量带入公式: 设买珍珠奶茶的顾客记为1,否则记为0,因为每一杯珍珠奶茶要放5g珍珠,因此要乘以5

把 5 除到右边,留下 $\sum_{i=1}^{100}X_i\sim b(100,0.5)$ , 则 $E(\sum X) = np = 50,Var(\sum X) = 25$ 将 $X_i$ 化成$X_i^*$ 用标准正态分布来计算。

现在,已经可以用$P(Y_n^*\leq y)\approx \Phi(y) = \beta$ 来计算了

解得,$x=288$ ,约等于290g 的珍珠,那么一共可以做58杯奶茶。

注:在这里,没有使用修正,但在其他题目中一定要修正,是y修正!

2. 已知$n,y$ 求 $\beta$

还是一样的奶茶店, 现在变成顾客以0.6 的概率点珍珠奶茶,且假定顾客点单独立,那么问58杯珍珠奶茶能让店主不拒单的概率是多少?

首先我们要把已知量带入到公式中去:

因为现在 $E(\sum X_i) = np = 60,Var(\sum X_i)=np(1-p) = 24$ ,带入得到:

我们看到,只要概率从0.5提升到0.6, 58杯奶茶的不拒单的概率从95% 降到了38%

3. 已知$y,\beta$ 求 $n$

还是一样的奶茶店,顾客点珍珠奶茶的概率为p,通过历史流水数据估算的值为$\hat p$, 现在要保证有$95\%$ 的把握使得估算值 $\hat p$ 与真实值p之间的差异不大于$1\%$ ,问至少要有多少流水数据?

这就是 已知$y,\beta$ 求样本数量$n$。我们令

那么,我们可以列出公式:

通过标准化,可以得到:

我们看到,这个式子是有上限的,也就是当p=0.5 时,n最大约为9604